Vor 20 Jahren sind wir gestartet – in einer Zeit, in der Twitter noch frisch war, das iPhone noch nicht das Licht der Welt erblickt hatte und das Internet sich selbst als „Web 2.0″ neu erfand. Wir sezierten Trends, waren neugierig auf alles, was mit Zukunft in Verbindung gebracht wurde, technikbegeistert, vielleicht auch etwas naiv.

Wenn André Winzer zurückschaut, meint er „damals sahen wir uns weniger als Zukunftsforscher*innen, sondern betrachteten Zukunft vor allem aus der Brille des strategischen Managements: Märkte beobachten, Signale erkennen, rechtzeitig auf die richtige Technologie setzen”.

Der Markt hatte da gerade Unternehmen hervorgebracht, die mit völlig neuen Geschäftsmodellen experimentierten. Neue Bezahlungsverfahren, Abonnement statt Einmalkauf, Copycat statt Eigenentwicklung. TechCrunch und Technology Review waren die Wissensquellen, Seedcamp-Events die Bühne, auf der man sah, wie schnell Kapital Ideen beschleunigen konnte – und wie oft es sie auch wieder auslöschte. „Wir waren wie auf Droge. Wir haben ganz viele dieser Gründer-Geschichten konsumiert und gesehen was möglich ist.” Und genauso regelmäßig sah man, wie Dinge an falschen Grundannahmen scheiterten. „Es ging auch immer darum, die Spielregeln infrage zu stellen.” Im Fokus standen weniger Produktverbesserungen, sondern grundlegend neue Verfahren, Modelle und Technologien, in denen man das Potenzial für disruptive Veränderungen sah, wie man so schön sagt.

Auch unsere Arbeitsweise war damals eine andere. Einfach machen und ausprobieren. Zukunftsfragen wurden über längere Zeiträume ausführlich und vor Ort diskutiert. Geteilte digitale Clouddateien in denen mehrere Redakteur*innen gleichzeitig editieren können gab es schließlich noch nicht. Ständig physisch zu Kund*innen und Projektpartner*innen fahren war ganz normal. Für Videokonferenzen waren die Übertragungsleistungen noch viel zu schlecht. Excel-Dateien wurden per Makro zusammengeführt. Bewertungszyklen für Expert*innen dauerten damit um ein Vielfaches länger als heute (dabei waren Entscheidungszyklen gern einmal zwischen 40 bis 50 Wochen). Dieser Raum für Tiefe in Arbeitstreffen mit Kund*innen ist es, den André im Rückblick vielleicht am meisten vermisst.

Was wir damals über die Zukunft virtueller Welten dachten:

2006 war Second Life kein Spielzeug. IBM hatte dort virtuelle Showrooms, Universitäten hielten Vorlesungen im digitalen Raum – und Schaltzeit kaufte das 1. deutsche virtuelle Konferenzzentrum: das Corecon Convention Center. Neu gestylt kam es dann als ComMeta.CC auf den Markt. Ob Meta sich deshalb umbenannt hat? Wer weiß das schon. 😉

Warum ein virtuelles Center? Einerseits wegen der spielerischen Freiheit: Weil es eine eigene Welt darstellte. Ein eigenes Ökosystem. Leicht zu gestalten und mit einer eigenen Ökonomie. Jede*r konnte sich austoben und weltweit konnten Konferenzen, Konzerte und gemeinsame Events stattfinden. Andererseits war der technische Grund sehr banal: Videoübertragungsraten reichten schlicht nicht aus für Videokonferenzen, für (schlecht) gerenderte virtuelle Welten mit Avataren jedoch schon.

„Mit Avataren geht das wesentlich einfacher. Sei wer Du sein willst!”

Eine damals gängige Zukunftsvorstellung lautete: Physische Räume für Lernen und Begegnung könnten zukünftig durch digitale ersetzt werden. Globale Konferenzen ohne Reisekosten. Effizienter, ortsunabhängig, skalierbar. Im gleichen Raum sein und dennoch mit dem Sitznachbarn quatschen oder chatten, ohne dass es jemand stört. „Das war damals Next Level Networking.”

Was wir jedoch unterschätzt hatten: die technischen Hürden für Benutzer*innen: „Wir selbst waren technisch nerdig genug und mitten im Game. Aber jemand, der noch nie einen Avatar gesehen hat, weiß nicht intuitiv wie man seinen Avatar steuern, fliegen oder beamen kann. Denn das ging nur via Tastaturshortcuts.”

Und dann gab es da die Serverspalten: Weil jeder Server nur eine begrenzte Landfläche rendern konnte, entstanden an den Grenzen zwischen Servern unsichtbare Lücken. Avatare konnten hineinfallen und steckten fest. Und dann gab es immer wieder Benutzer*innen, die sich da nicht selbst wieder ausmanövrieren konnten. Einfach mal schnell Bildschirmteilen mit dem Techsupport war damals ja noch nicht.

Hinzu kam die Avatar-Frage: Wie sollen sie aussehen? Wenn wir Avatare für Kund*innen erstellten, war die Erwartung oft, dass die Avatare den realen Benutzer*innen möglichst ähnlich sahen, bzw. eine getunte Version von ihnen darstellten. Ein bisschen schöner – muskulöser, attraktiver, mit längerem Haar. Das war technisch möglich. Aber woher trifft man deren Geschmack? Das fiel schon den historischen Portraitmalern unglaublich schwer: Das Dilemma entweder zu realistisch zu malen (und den Auftraggeber zu beleidigen) oder zu schmeichelhaft (und Erwartungen zu wecken, die die Realität nicht einlösen kann). Jedenfalls stylte Schaltzeit Avatare nach Fotos der Teilnehmenden – unglaublich zeitaufwendig. Cool war dann auch immer, wenn Menschen ihre Avatare ganz anders stylten. Manche kamen als Fisch, Krebs oder Alien in unsere virtuellen Veranstaltungen.

Doch das wirtschaftliche Ende unseres ComMeta.CC im Second Life kam schnell. Einen Monat nach Fertigstellung des Konferenzzentrums gab es plötzlich einen Baukasten für 4,99 Dollar, der funktional dasselbe bot. Zigtausende Euro Investition gegen fünf Dollar. Kein Mensch wollte ein individuell entwickeltes Konferenzzentrum kaufen, wenn es den Standard-Baukasten gab.

Damit war das Projekt für uns gelaufen, aber noch lange nicht für das Finanzamt. Drei Jahre Hin und Her, weil noch gar nicht klar war, wie so ein Konferenzzentrum bewertet werden sollte: Wie schreibt man ein virtuelles Anlagevermögen in Deutschland ab (Gebäudeabschreibung auf 35 Jahren ist normal), das auf amerikanischen Servern lag, einem Avatar gehörte, der in der Währung Linden-Dollar bezahlt hatte, und AGBs, die den Besitz sämtlicher virtueller Güter ohnehin bei Linden Labs verorteten?

„Das Finanzamt war auf solche Fälle gar nicht gefasst. Wie kann ein Wert eines Digitalgutes so schnell verfallen? Unser Fehler: Wir hatten es als Investition und nicht als Marketingmaßnahme gesehen.”

Die Rechtsverteidigungskosten trugen wir selbst. Was neben dem unverhofften Papierkrieg blieb: die Erkenntnis, dass sich menschliches Erleben vor Ort doch nicht so einfach digital überbrücken lässt wie von uns Technerds zuerst gedacht.

Auch wenn Second Life mittlerweile längst aus ernsthaften Strategien verschwunden ist, die grundlegende Idee ist ein Stückweit geblieben – und kehrte mit neuem Gesicht immer wieder zurück. Spätestens Corona bewegte uns dazu, virtuelle Formate wieder ernst zu nehmen, diesmal mit ausgereifterer Technik. „Wenn sich die Rahmenbedingungen verändern, dann muss der Austausch sich auch verändern.” Virtuell ist zwar nicht immer alles möglich, aber vieles, solange man konzeptionell die User Journey ausreichend bedenkt.

Auf Augmented Reality und aufwendige VR-Headsets setzten wir dabei zum Glück nicht. Das überließen wir Facebook, die mit dem Metaverse die Zukunftsvorstellung aufgriffen, menschliche Interaktion auf eine riesige virtuelle Plattform auszulagern, die wir alle über VR-Headsets besuchen. Hätten sie uns gefragt, dann hätten wir sie vielleicht vor den Kosten gewarnt, denn wir hatten gelernt. 😉 Immersion und virtuelle Welten brauchen technische Standards, die mit einfacher Hardware und vor allem auch für „normale” Nutzer*innen niederschwellig funktionieren, nicht nur für Gaming-Enthusiast*innen. Metas Horizon Worlds wird nun schrittweise zurückgefahren: Ab dem 15. Juni 2026 verschwindet die App vollständig aus dem Quest Store. Das Ergebnis: über 70 Milliarden Euro Verlust in knapp fünf Jahren. Was das wohl steuerlich für Meta bedeutet, steht auf einem anderen Blatt. 😉

Was bei Schaltzeit von all den virtuellen Welten bleibt, ist unser heutiger Eventtrack: Getreu dem Motto „Experiences for Forward Thinking” probieren wir seit 20 Jahren neue Lösungen für on-site/virtuell/hybrid aus und sorgen auch bei mehrtägigen Veranstaltungen für Überraschungsmomente, gute Interaktionen und das Orchestrieren einer geeigneten Toollandschaft. Egal ob globale Leadership-Strategiekonferenzen, Learning Journeys oder kompakte Workshops. Auch vor on-site-Veranstaltungen wie der Organisation des EIC Innovators’ Summits haben wir keine Scheu.

Was die (vergangenen) Zukunftsvorstellungen angeht: Virtuelle Räume sind für uns heute kein zukünftiger Ersatz mehr für physische Begegnung, aber sie sind auch keine gänzlich gescheiterte Utopie. Immer noch beeindruckt von täglich neuen Möglichkeiten der Tech sind wir dabei mittlerweile auch etwas mehr auf dem Boden der Tatsachen angekommen. Über die 20 Jahre haben wir unser Handwerkszeug geschliffen. Wenn du über Austauschformate zu Zukunfts- und Innovationsfragen nachdenkst, stehen wir bereit.

Was wir damals über die Zukunft der Elektro-Autos dachten:

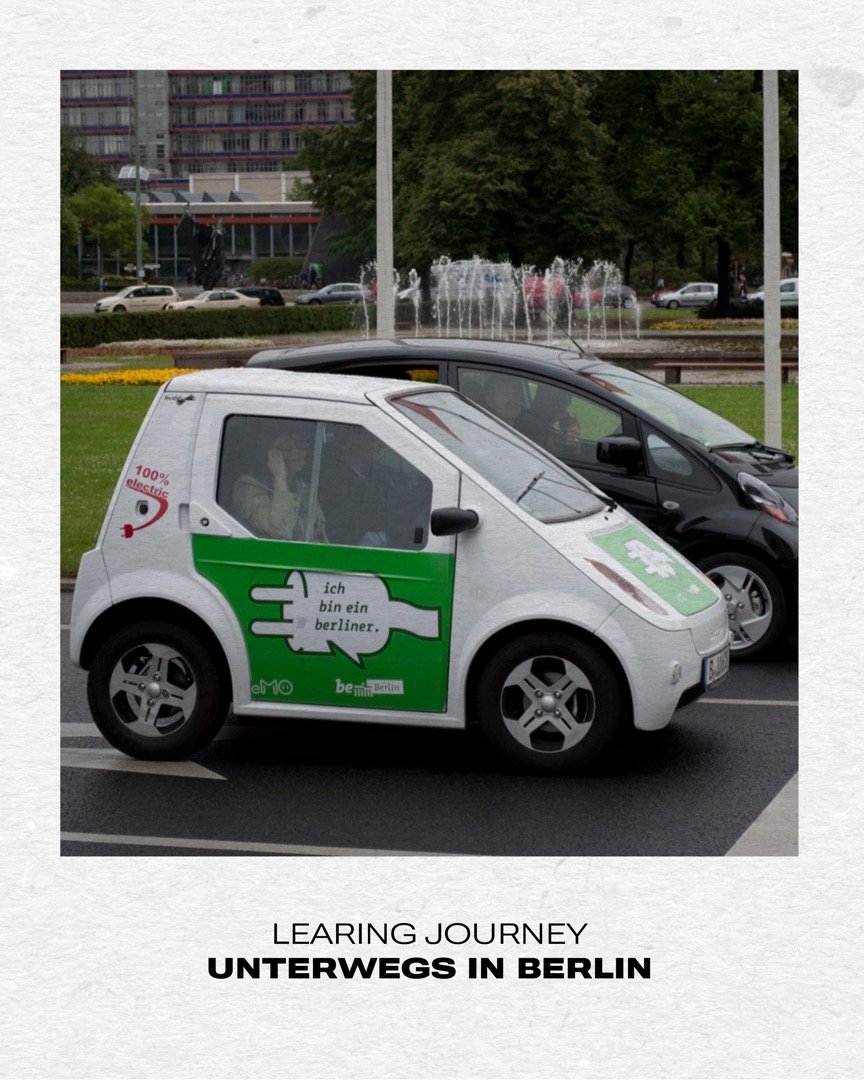

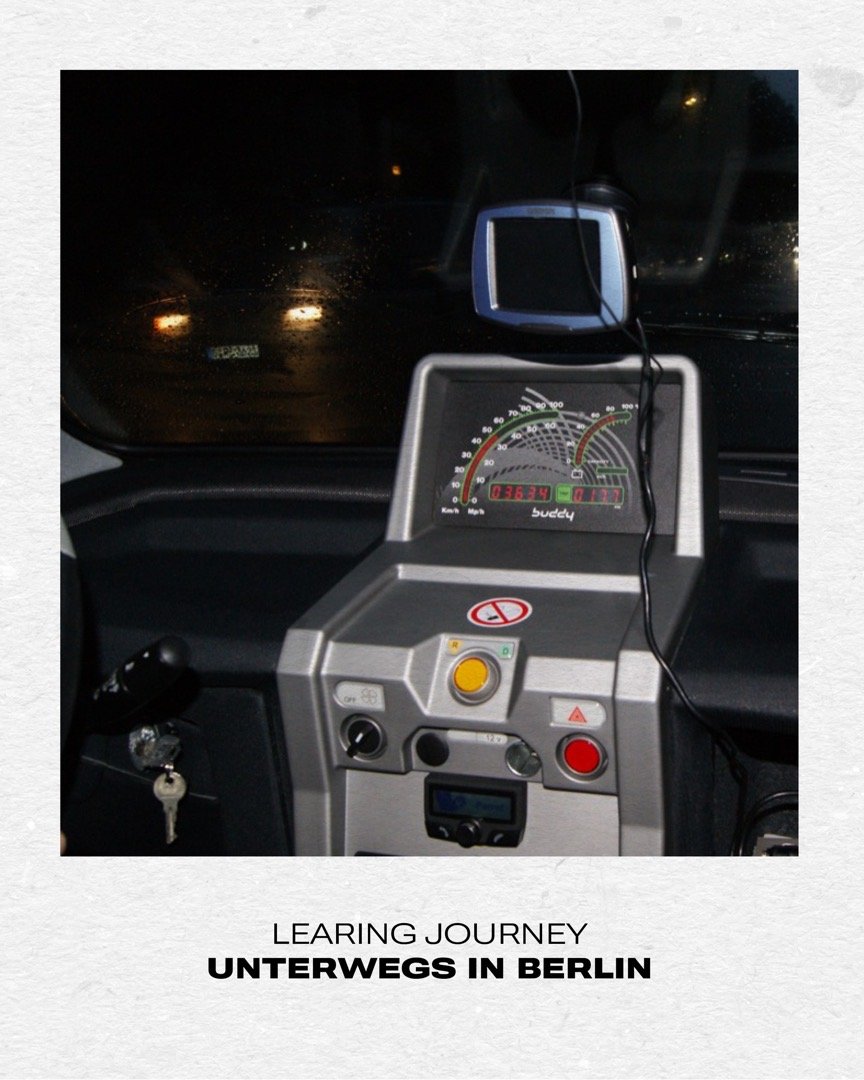

2011 organisierten wir für Fahrzeugentwickler*innen eines großen Automobilkonzerns eine Learning Journey durch Berlin zum Thema E-Mobilität. Das Fortbewegungsmittel zwischen den Stationen: Natürlich Elektroautos. Das Problem: Es gab kaum welche.

„Die E-Autos, die wir gefunden hatten, waren entweder gerade am Entstehen oder echte Bastlerfahrzeuge – es sah teilweise aus, als ob jemand ein Schweißgerät hatte und das Ding zusammengebaut hat.”

Ein Moment ist dabei unvergessen, als eine Teilnehmerin ins Auto stieg, den Startknopf drückte und sich wunderte:

„Der geht ja gar nicht an.” – „Wieso, der läuft doch.” – „Aber ich hör’ ja gar nichts!”

Das war 2011. E-Mobilität war damals noch völlig fremd, inklusive des Fahrgefühls und der leisen Antriebstechnologie.

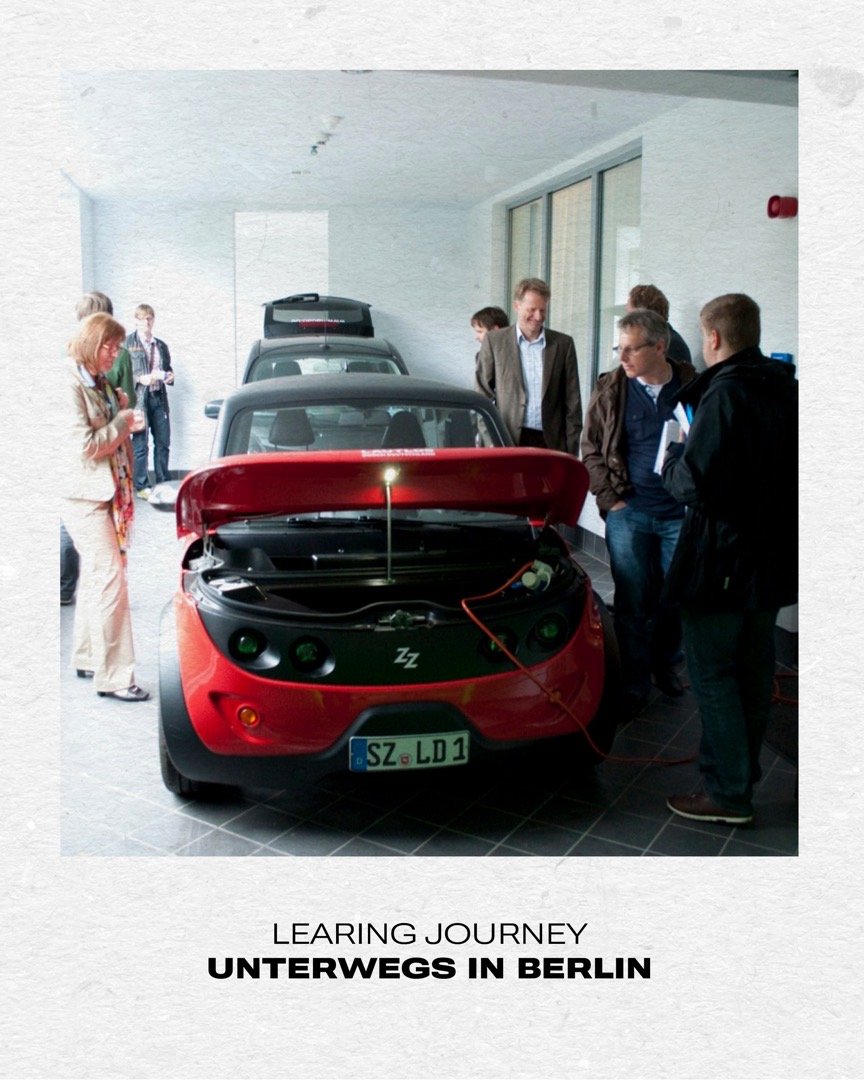

Die Lernstationen unserer Learning Journey spielten mit verschiedenen Perspektiven. Wir ließen die Teilnehmer*innen verschiedene Missionskarten erfüllen und dafür in Rollen schlüpfen: als großer deutscher Automobilhersteller, als Mitarbeiter von Bamboo Cars aus Thailand, als norwegischer Bastler-Schuppen, als Tesla, als BYD, als Kind auf dem Rücksitz, als Umweltamt, als Wirtschaftsministerium. Die Einsicht dahinter: Wer die Zukunft der Mobilität gestalten will, muss zuerst verstehen, wessen Zukunft hier eigentlich gedacht wird.

„Welches grundsätzliche Bild haben Automobilhersteller von Mobilität? Diese naheliegende Frage war durchaus interessant.”

Eine Station der Missionskarten führte die Gruppe dabei in die T-Labs, dem Forschungslabor der Deutschen Telekom. Dort stand ein voller Kofferraum – vollgestopft mit Technik, für eine einzige Funktion: Musikstreaming. Die Übertragungsraten damals hätten nicht ausgereicht, um einen Song over the air zu streamen. Auch die rechtlichen Lizenzen deckten nur ein technisches Zwischenspeichern ab. Der Song musste auf einer Festplatte gebuffert werden.

Heute ist das Buffering kein Thema mehr, das Smartphone übernimmt den Job. Dank Medienkonvergenz drückt ihr heute auf Spotify und das Auto spielt ab. Dass wir unsere Apps ins Auto mitnehmen wollen, hatten wir damals noch nicht ganz bedacht. Dank geteilter Playlist ist heute gemeinsames Streaming möglich. „Damals brauchte man dafür einen ganzen Kofferraum. Jetzt kann man ihn wieder für Gepäck verwenden.”

Insgesamt schienen Zukunftsvorstellungen von Automobilen an manchen Punkten sehr auf die damals gegenwärtigen technischen Grenzen fokussiert. Und auch das damalige Zukunftsbild der E-Mobilität war bei manchen Autoherstellern noch ein eher belächelndes – Spaltmaße stimmen nicht, Reichweite haut nicht hin, Beschleunigung mangelhaft. Ladegeschwindigkeit? Lieber nicht drüber reden. Die hohen Anschaffungspreise durch teure Akkus und maue Gewinnaussichten für Hersteller waren zentrale Knackpunkte in Zukunftsfragen der E-Mobilität.

„Aber das sind alles Dinge, an denen man arbeiten kann. Und das ist passiert – Stück für Stück. Wer das unterschätzt, kann schnell tief fallen.”

Auch die Ladeinfrastruktur wurde als zentrales Hindernis ins Feld geführt. Ein Berliner Startup wollte daher aus jeder Straßenlaterne eine Ladesäule machen. Was dann wirklich kam: Tesla hat keine Laternen umgerüstet, sondern ein eigenes Supercharger-Netz aufgebaut. Und technisch hatte Tesla etwas gemacht, das niemand auf dem Zettel hatte: Software mit ins Spiel gebracht – um damit viele Akkus zu verknüpfen, anstatt zu warten, bis eine neue super Batterie entwickelt wird:

„Die haben einfach gesagt: Wir stapeln viele kleine Notebook-Akkus zu einem großen Stromreservoir. Software regelt den Rest.”

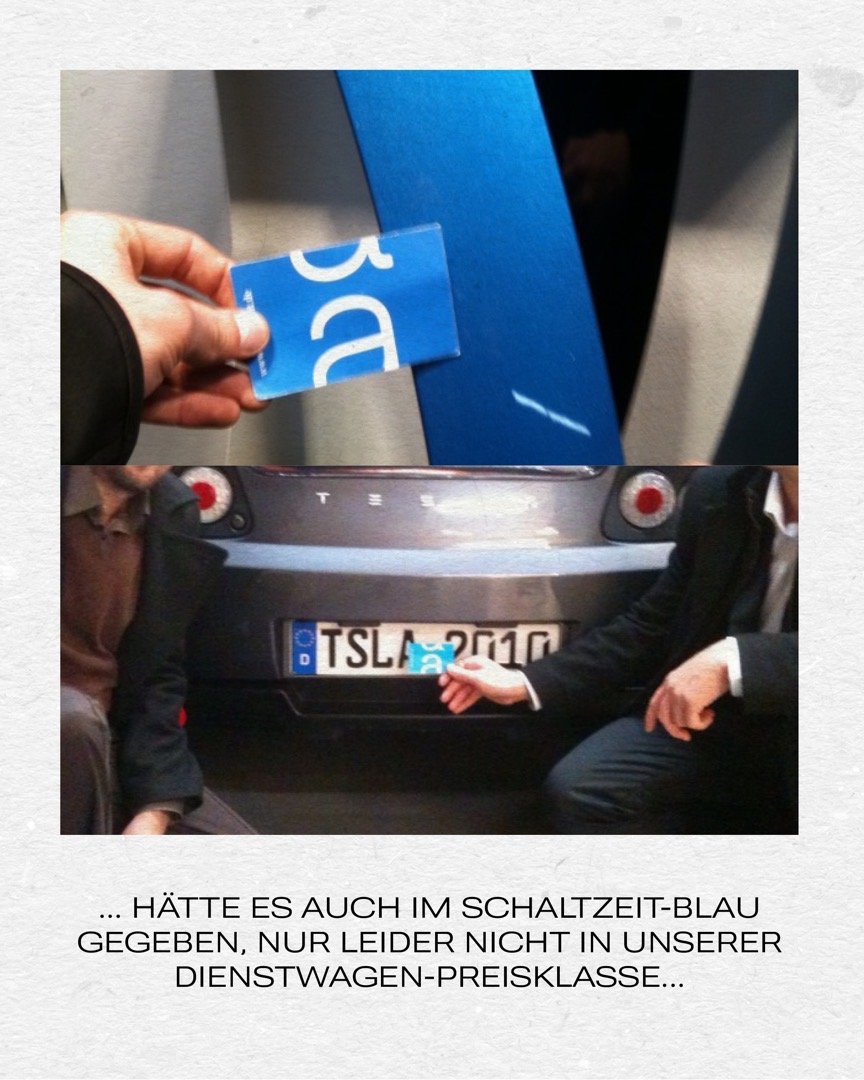

Notebook-Akkus stapeln und per Software aussteuern – klang zunächst nach Bastelkeller, wurde aber Weltmarktführer. Und hatte uns damals schon beeindruckt: 2010, im Jahr zuvor, fuhren wir mit unserem Team spät abends zufällig an dem ersten deutschen Tesla-Showroom in München vorbei, erinnert sich André. Wir schauten nur das Schaufenster an, doch das Ladenpersonal machte extra nochmal auf, um uns den Tesla Roadster zu präsentieren. Auch wenn dieser Sportwagen für unsere Learning Journey ein Jahr später leider nicht leihbar war (sondern nur in sechsstelliger Preisklasse zum Verkauf stand), spürte man schon da den Innovationsgeist der E-Mobilität.

Trotzdem: Was damals die naheliegende Fanboy-Position à la „Elon ist ein Visionär, Tesla revolutioniert alles” war, hat sich inzwischen für viele zu einer deutlich komplizierteren Haltung entwickelt. Was man nicht zuletzt an Auto-Stickern wie „I bought this car before i knew Elon was crazy” sieht. Man könnte sagen, auch Zukunftsvorstellungen über Personen haben ein Verfallsdatum.

Aber zurück zur deutschen E-Mobilität: Das Geschäftsmodell-Dilemma der deutschen Automobilindustrie – hohe Margen beim Verbrenner, unsichere Rentabilität beim E-Auto – war schon 2011 sichtbar… und hat vielleicht ein längeres Verfallsdatum als uns lieb gewesen wäre.

Was wir damals über die Zukunft von KI dachten:

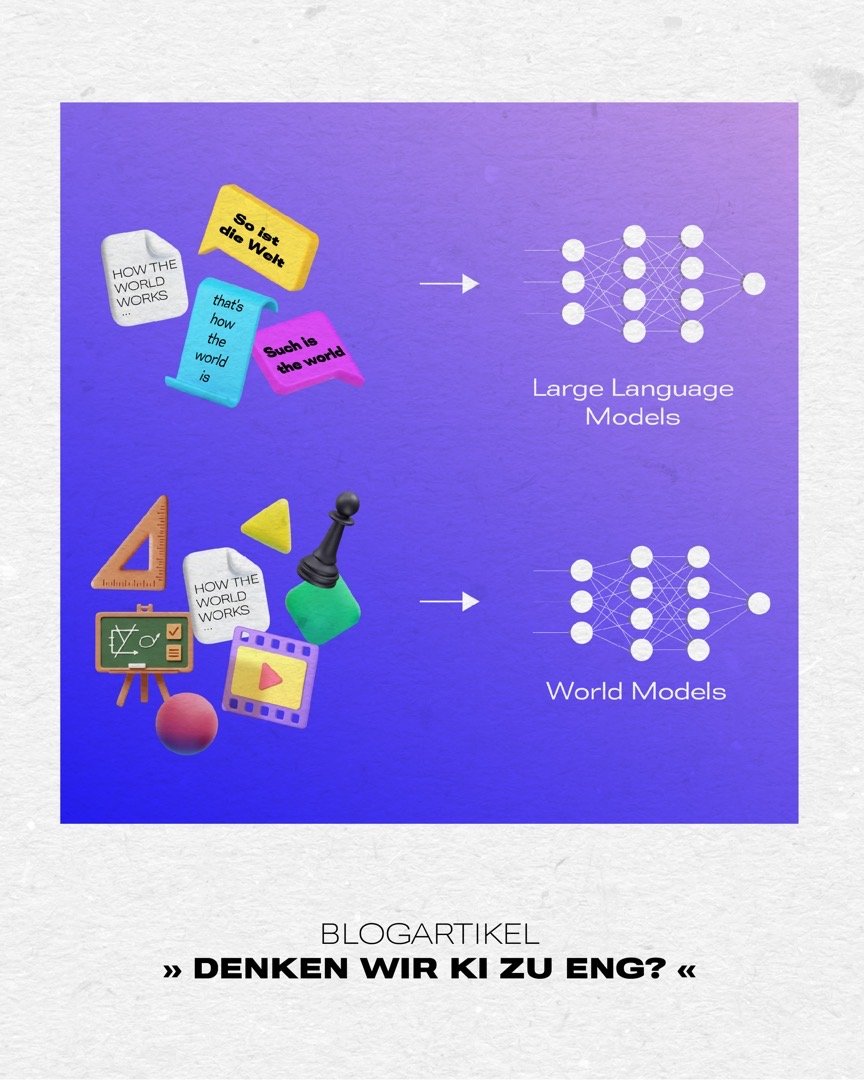

KI war 2006 noch kein Buzzword in der Dimension der letzten Jahre. Was damals unter „smarter” Technologie verstanden wurde, klingt heute bescheiden: Bilderdatenbanken verschlagworten. Oder ein Konzept für zukünftige Kühlschränke, die erkennen, was drin ist. Obwohl die Rechenkapazität zur Realisierung solcher Kühlschrank-Konzepte damals schlicht nicht vorhanden war. Man dachte nämlich noch, man müsse die Rechenkapazität direkt ins Gerät stecken, statt sie in Serverfarmen auszulagern. „Ich erinnere mich noch an Demonstrationen zu Smart Homes, wo der Techniker im Dachboden die Technik verwaltete, um die Illusion von ‚alles funktioniert jederzeit’ im Showroom aufrecht zu erhalten. Oder an einen Roboter im Smart Living Showroom, der den Job hatte, den verlegten Schlüssel zu finden – diesen allerdings nur an speziellen ‚Verlustorten’ finden konnte.” KI war noch keine funktionierende Alltagsanwendung, eher eine Vision: die technischen Verfahren noch nicht skaliert und zu wenige Trainingsdaten verfügbar.

Trotzdem waren grundlegende KI-Anwendungsideen durchaus in den Branchen präsent: Wissen aggregieren, Informationen automatisiert auswerten, darin schneller werden als die Konkurrenz. Bei uns waren das damals Ontologiebäume, Feed Reader, RSS-Protokolle und unser hauseigenes Projekt namens ITsy Bitsy: Ein Webcrawler, der aus verschiedenen Quellen Informationen einsammelte und in eine Datenbank übertrug.

„Wir haben ein halbes Jahr an dem Prototypen gearbeitet und dann auch einen Preis der Bayer AG für ITsy Bitsy gewonnen.”

Doch dann kam die rechtliche Realität: Webscraping war in Deutschland und der EU zu diesem Zeitpunkt schlicht illegal. Man hatte die technische Möglichkeit, Wissen auszuwerten – man durfte es aber nicht in Datenbanken ablegen und verarbeiten.

„Wozu sammle ich Daten? Wir wollten Muster und Trends erkennen, Signale zu Entwicklungen verdichten und zusammenführen. Aber die technischen Tools dafür zu bauen war rechtlich nicht möglich. In anderen Ländern schon. Also hieß es, die Schnittstellen ausländischer Angebote zu konsumieren, statt die eigene Entwicklung zu forcieren.”

Zwischendurch gab es dann auch die Voice-Assistant-Welle. Alexa, Siri, Cortana – für einen Moment schien Sprachsteuerung das nächste große Ding zu werden. Wir arbeiteten zum Beispiel für einen Kunden an der Frage „Was passiert rechtlich mit Verträgen, die ich mündlich abgeschlossen habe?” Dann ebbte die Welle wieder ab. Und jetzt, mit LLMs, kommt Voice als Interaktionsform mit KI zurück.

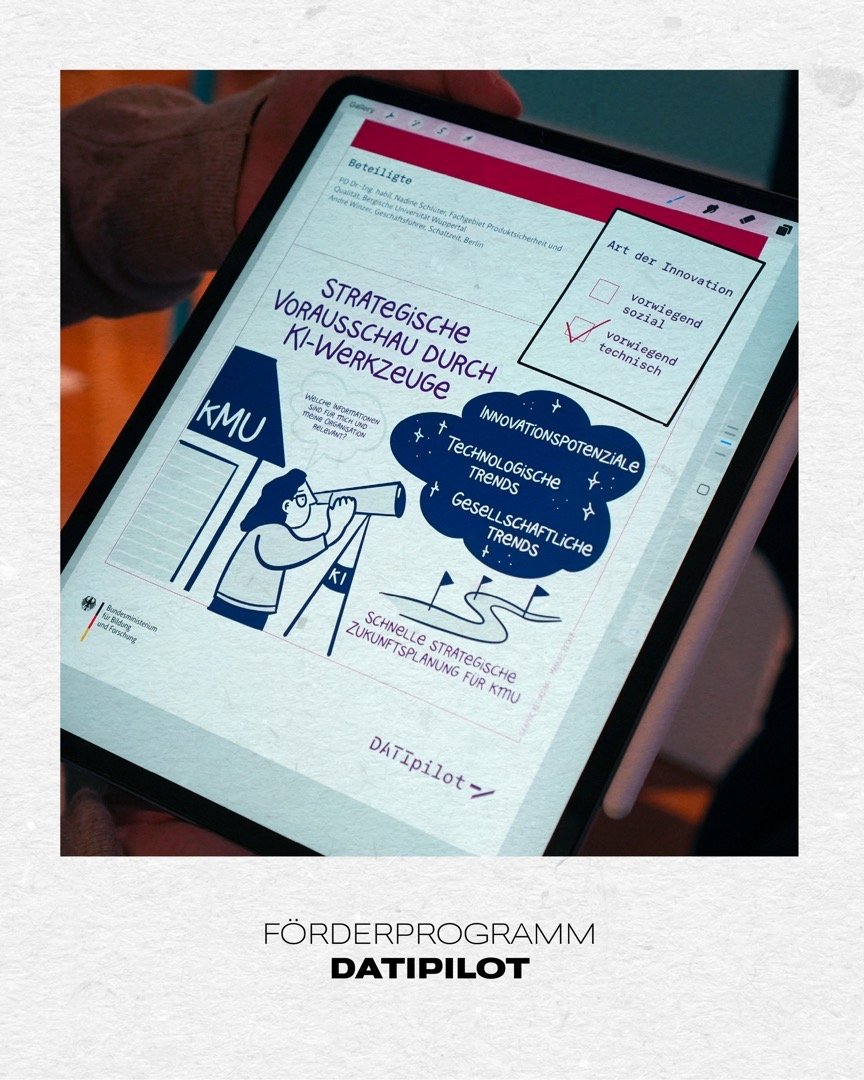

Ab 2020 implementierten wir dann KI systematisch in Foresight-Prozessen, unter anderem für die strategische Vorausschau eines Bundesministeriums. Seitdem haben wir ein breites Spektrum erkundet: Horizon Scanning mit Agenten, automatisches Clustering und Bebilderung, generierte Szenarien, Prozess-Workflows mit flexiblen LLM-Schnittstellen, Unterstützung bei Workflows von Innovationswettbewerben, Radare als automatisierte Meta-Studien, niederschwellige Futures-Literacy-Anwendungen wie unser Szenario-GPT – und zuletzt Vibe-Coding-Experimente, mit denen wir neue Wege ausprobieren, wie sich Ideen direkt in funktionierende Werkzeuge übersetzen lassen.

Während viele Akteur*innen der Foresight-Branche vor einigen Jahren vor allem noch theoretisch debattierten – KI im Foresight: vielversprechend oder unprofessionell? – probierten wir Hands-on aus und diskutierten unsere Erfahrungen & Einschätzungen: Was ist denkbar? Was funktioniert? Was bedeutet das? Wollen wir das?

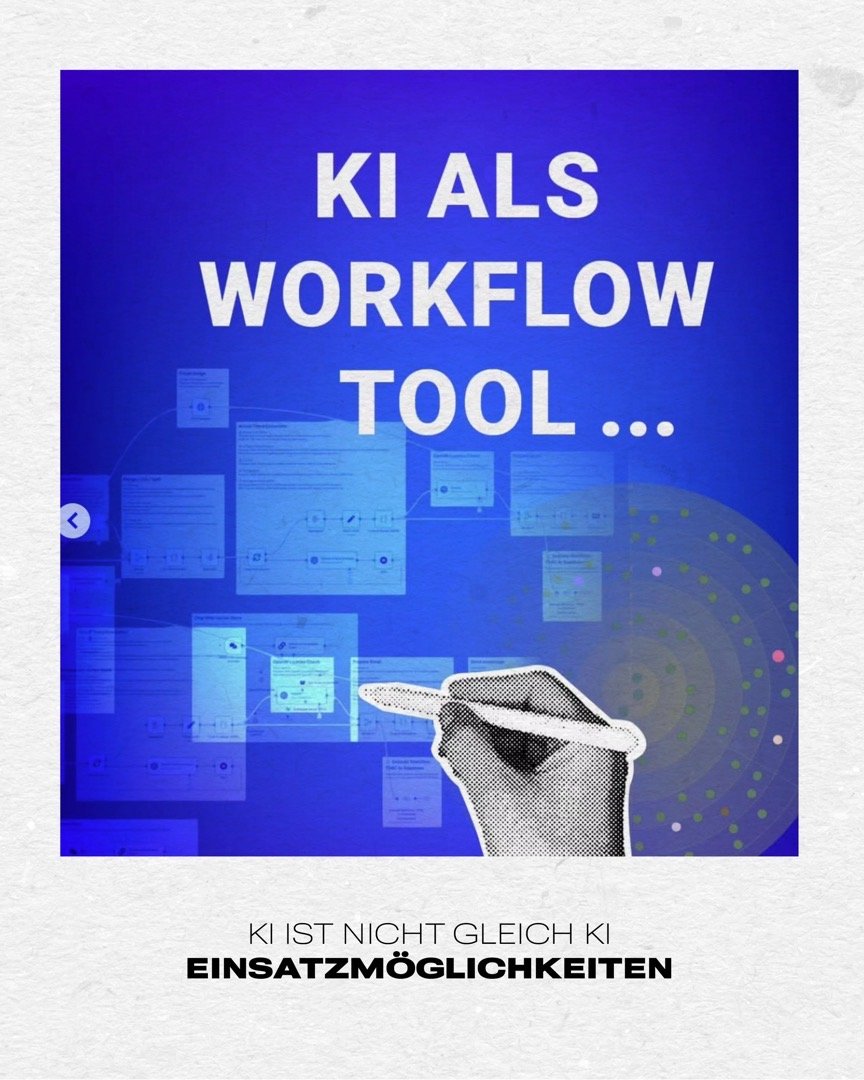

Klar ist dabei: KI ist nicht gleich KI. Zwischen einem einfachen Custom-GPT und einem strukturierten Workflow-System liegt ein breites Spektrum – und die entscheidende Frage ist selten „Soll ich KI verwenden?”, sondern eher „Was will ich eigentlich erreichen?”, um dann zu schauen, ob und wie KI dabei sinnvoll eingesetzt werden kann.

Dabei merken wir immer wieder: Die Fähigkeit, einen guten Prompt zu formulieren oder einen funktionierenden automatisierten Workflow aufzusetzen, ersetzt nicht das Wissen, das man braucht, um die Ergebnisse einzuordnen. Die eigentliche Kompetenzfrage verschiebt sich dabei oft weg von der technischen Machbarkeit zu „Wer findet eine gute Balance aus pragmatischem Effizienzgewinn und kritischer Überprüfung?”

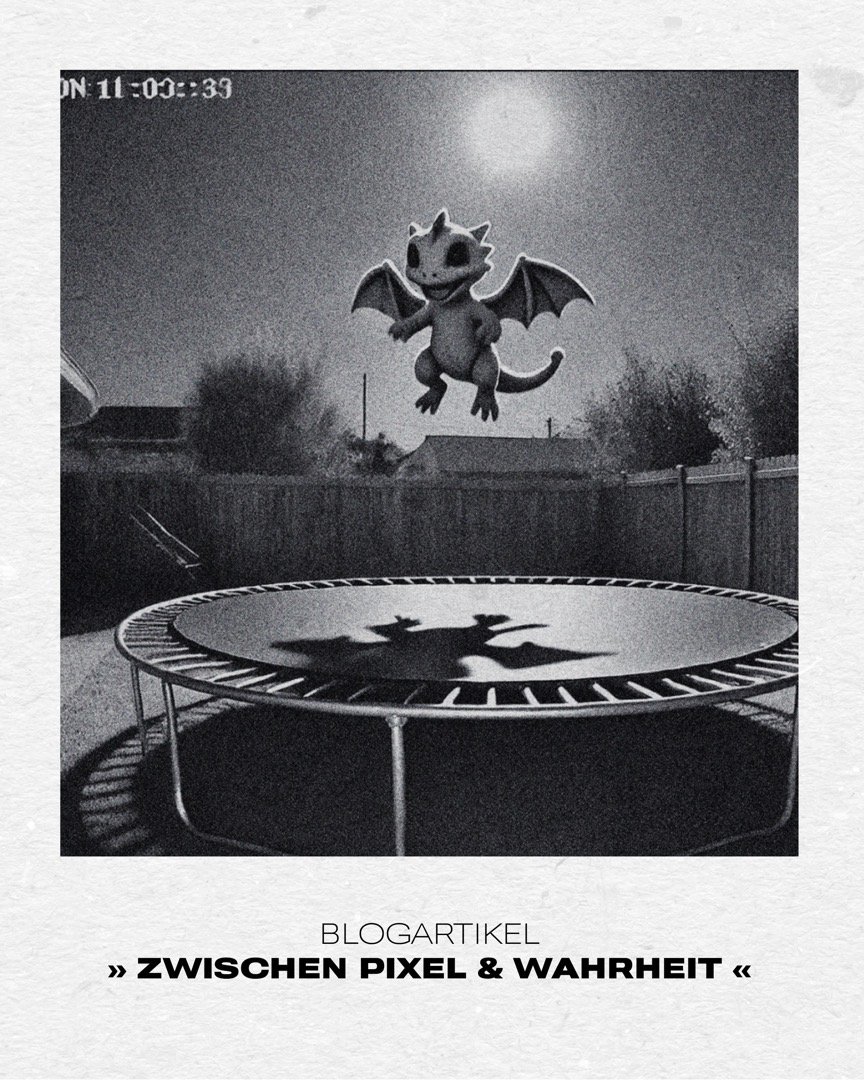

Dazu kommen strukturelle Fragen, die wir nicht ausblenden können: Gute Modelle sind teuer und nicht für alle erschwinglich. Machtstrukturen und Vorurteile schreiben sich in Algorithmen fort. Und dort, wo synthetische Bilder, Texte und Videos zunehmend schwer von Realität zu unterscheiden sind, verschiebt sich der Fokus von Information zu Verifikation. Wie verändern sich unsere Evidenzformen? Was bedeutet das für unser Vertrauen in Wissen? Was bedeutet dies für die (Daten-)Grundlage von Foresight-Prozessen?

Was wir damals über Trendreports dachten:

Die eigene Trendreport-Marke war ein weiterer Anlauf aus den Anfängen von Schaltzeit. Die Economies of Scale and Scope lagen wirtschaftlich auf der Hand: Etablierte Anbieter verlangen für Report-Abos schnell fünfstellige Jahresbeträge – bei gleichzeitiger Begrenzung auf wenige Lesende. Das klang nach Musik. War es aber nicht. Wer im Trendreport-Geschäft verdienen will, braucht entweder die Marktmacht einer etablierten Branchenmarke – oder ein Modell, bei dem nicht nur die Abonnenten zahlen, sondern auch die Anbieter von Lösungen.

Wir beobachteten, wie andere Anbieter ihre Trends mit Neologismen versahen wie „ShyTech”. Wir dachten: Das machen wir auch. Ad-hoc-Scouting, schnelle Reports, ein eigenes Ökosystem mit coolen Begriffen.

„Wir hatten damals die Illusion, dass wir eine eigene Marke werden können.”

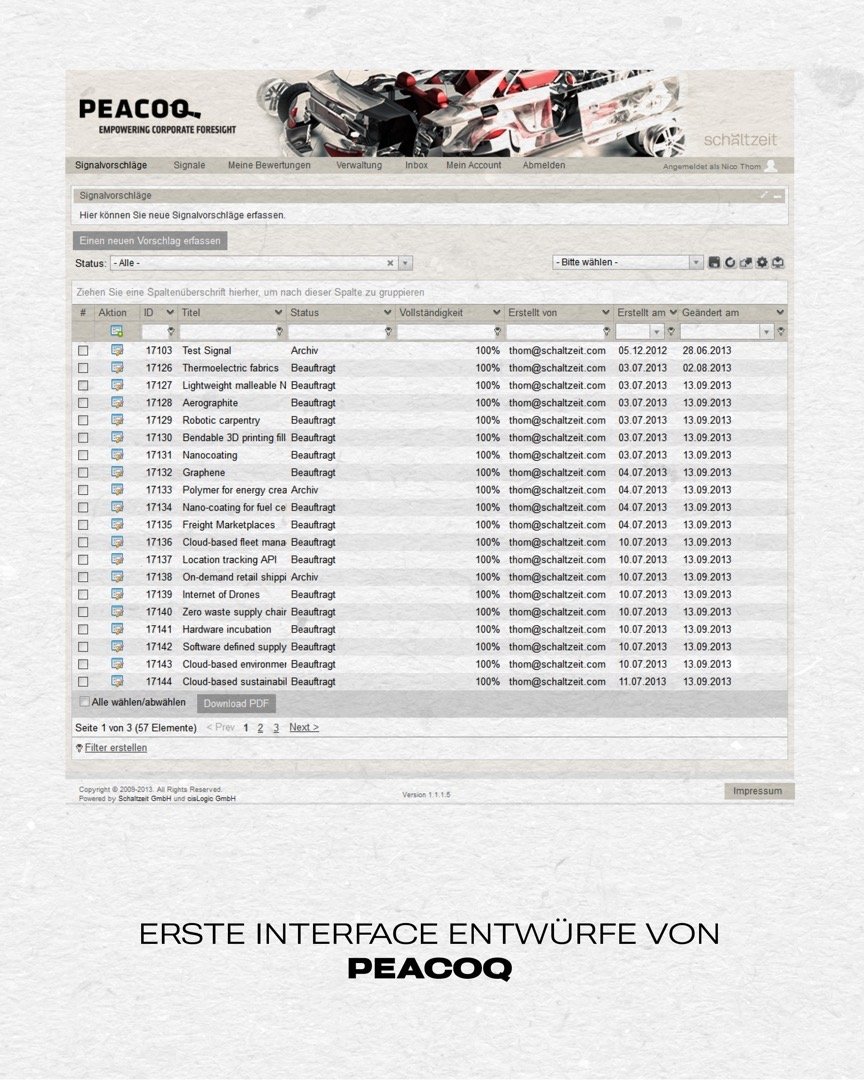

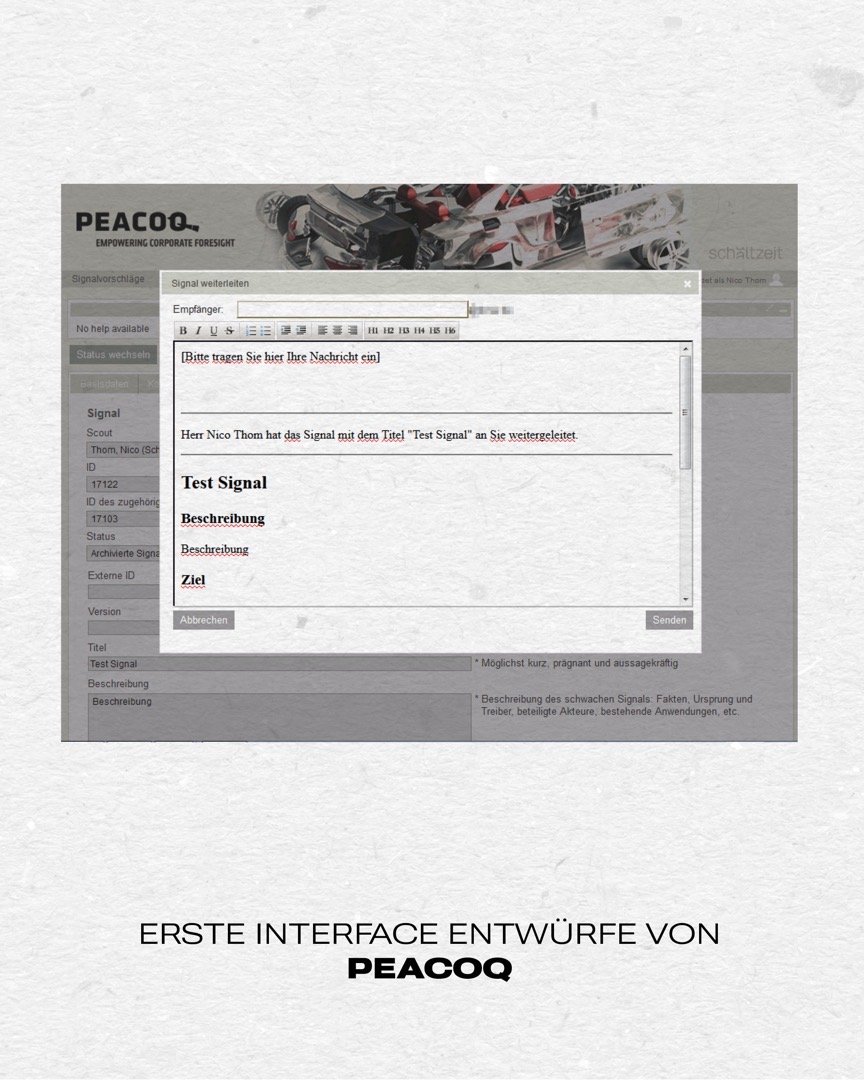

Damals entstanden auch die ersten Versionen unserer Software PEACOQ (damals noch „Peacock”): Eine Trenddatenbank als Grundlage der Reports, die wir verkaufen wollten. Warum wir den Pfau als Namensgeber wählten: „Er hat mit seinen Federn einen Fächer wie ein Trendradar und außerdem wahnsinnig viele Augen.” Später fanden wir dann heraus, dass der Pfau im sog. Foresight-Zoo zufälligerweise keinen so guten Ruf hat. Die Tiere des Foresight-Zoos beschreiben metaphorisch verschiedene Foresight-Phänomene. Neben den schwarzen Schwänen, grauen Nashörnern, dem „Boiling Frog” oder dem roten Hering gibt es dort auch den Pfau („Peacock”). Er steht für (populistische) Ablenkungsmanöver, in denen ein stolzer Pfau mit seiner Federpracht so viel Aufmerksamkeit auf seine Zukunftsnarrative zieht, dass wichtigere Zukunftsthemen unbemerkt im Hintergrund verschwinden.

Naming hin oder her, was wir schnell merkten: Eine Trendreport-Marke braucht entweder extrem viel Marketing oder eine wissenschaftlich hohe Reputation durch anerkannte Institute. Beides hatten wir nicht.

„Die Zahlungsbereitschaft war nicht da. Kein Mensch wollte für Schaltzeit-Reports zahlen.”

Was jedoch funktionierte, war White-Label-Research: Firmen zahlen, wenn der Report unter ihrer eigenen Marke erscheint.

Eine Zukunftserwartung damals: Datenauswertungen werden immer umfassender – und da mehr Daten zu mehr Klarheit führen, könnten Strategieentscheidungen zukünftig zunehmend einfacher werden. Was wir dabei schnell lernten: Das eigentliche Problem ist selten der Mangel an Wissen. Stattdessen sind es nicht selten die fehlende Kapazität oder institutionelle Strukturen, strategisch mit dem vorhandenen Wissen umzugehen. Damit entwickelte sich auch PEACOQ über die Zeit weiter in seinen Anwendungen.

So wurde PEACOQ von der klassischen Trenddatenbank und schön gelayouteten Trendberichten als Endprodukt im Laufe der Zeit ein System, das die individuellen Wege abbildet, wie Foresight, Innovation und Community-Management in einer Organisation gedacht werden, bspw. in Kombination mit Futures-Literacy-Formaten. Mit Raum für anstrengende Diskussionen und die Suche nach den eigenen Blindspots.

Was bleibt?

Auf die Frage, was sich in 20 Jahren grundsätzlich verschoben hat, antwortet André ohne Nostalgie:

„Ich werde nicht mehr so schnell high. Ich denke nicht sofort, jedes Thema wird eine Weltrevolution auslösen – dafür hat man zu viele Hypes gesehen.”

Man hat zu viele Zyklen erlebt: zu viele Dinge, die durch die Decke gehen sollten und es nicht taten; zu viele Dinge, die belächelt wurden und es dann doch taten. E-Autos wurden belächelt. Second Life wurde ernst genommen. Voice-Assistenten kamen, gingen, kommen wieder.

Das bedeutet noch lange nicht, dem Zynismus zu verfallen oder paralysiert das Handtuch zu werfen, sondern öfter auch mal einen Schritt zurückzutreten – nicht nur um zu hinterfragen, wie neue Technologien die Spielregeln potenziell verändern könnten, sondern auch um zu hinterfragen, aus welchem Spiel heraus man überhaupt auf die Technologien schaut.

Was sich dabei nicht verändert hat: die Neugier. Und die Überzeugung, dass gute Zukunftsarbeit dort entsteht, wo Menschen – mit welchem Werkzeug auch immer – motiviert, kreativ und kontextbewusst denken und gestalten wollen. Vor 20 Jahren mit Flash-Radar-Animationen auf polierten Edelstahlsäulen und Excel-Makros. Heute mit LLM-Workflows, Futures Literacy und Vibe-Coding-Prototypen. Der Anspruch ist derselbe geblieben. Wir wollen Wissensmanagement und Lernprozesse unterstützen, um Zukunft mitzugestalten. Dafür konstruieren wir nicht mehr nur Trendanalysen und Zukunftsszenarien, sondern dekonstruieren auch Standpunkte hinter den Zukunftsvorstellungen, um deren Denkmuster zu hinterfragen: Wessen Zukunft denken wir hier eigentlich – und auf welchen Annahmen bauen wir auf? Wo lohnt es sich weiterhin, die Spielregeln kritisch zu hinterfragen?

Mal sehen, was wir in den nächsten 20 Jahren dazu lernen.